隨著2020年度全國(guó)監(jiān)理工程師執(zhí)業(yè)資格考試的結(jié)束,眾多考生正熱切關(guān)注著成績(jī)查詢的最新動(dòng)態(tài)及相關(guān)服務(wù)信息。本文將為您梳理成績(jī)查詢的官方渠道、時(shí)間預(yù)測(cè),并詳細(xì)介紹票據(jù)信息咨詢服務(wù)的相關(guān)內(nèi)容,助您順利獲取考試結(jié)果并處理后續(xù)事宜。

一、2020年監(jiān)理考試成績(jī)查詢最新消息

截至目前,2020年監(jiān)理工程師考試成績(jī)尚未正式公布。根據(jù)往年慣例,考試通常在5月舉行,成績(jī)一般在考后2-3個(gè)月發(fā)布,預(yù)計(jì)2020年度的查詢時(shí)間可能在2020年7月下旬至8月上旬。具體時(shí)間需以官方通知為準(zhǔn),考生應(yīng)密切關(guān)注以下渠道:

- 中國(guó)人事考試網(wǎng):這是查詢成績(jī)的官方平臺(tái),考生可登錄網(wǎng)站,在“成績(jī)查詢”欄目輸入準(zhǔn)考證號(hào)和身份證號(hào)進(jìn)行查詢。

- 各地人事考試中心官網(wǎng):部分省份會(huì)同步發(fā)布成績(jī)信息,建議考生同時(shí)關(guān)注本地考試機(jī)構(gòu)的通知。

- 短信或郵件提醒:部分地區(qū)提供成績(jī)推送服務(wù),考生可在報(bào)名時(shí)留意相關(guān)選項(xiàng)。

查詢時(shí),請(qǐng)準(zhǔn)備好個(gè)人信息,并確保網(wǎng)絡(luò)環(huán)境穩(wěn)定。若遇系統(tǒng)繁忙,可錯(cuò)峰嘗試。成績(jī)公布后,合格標(biāo)準(zhǔn)(通常為各科目滿分的60%)及證書領(lǐng)取事宜將陸續(xù)發(fā)布,請(qǐng)考生保持關(guān)注。

二、票據(jù)信息咨詢服務(wù)解析

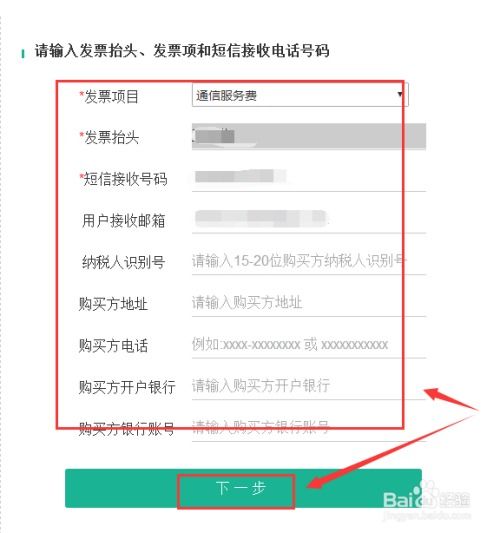

在考試及成績(jī)查詢過(guò)程中,考生可能涉及費(fèi)用票據(jù)(如報(bào)名費(fèi)、培訓(xùn)費(fèi)發(fā)票)的處理需求,票據(jù)信息咨詢服務(wù)應(yīng)運(yùn)而生。這項(xiàng)服務(wù)旨在幫助考生解決票據(jù)相關(guān)問(wèn)題,包括:

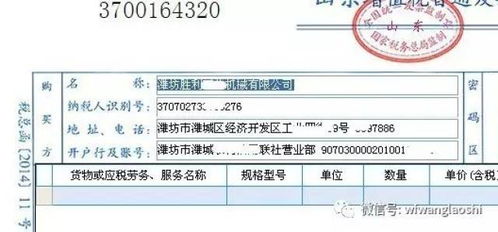

- 票據(jù)開具與獲取:指導(dǎo)考生如何通過(guò)官方渠道申請(qǐng)和下載電子發(fā)票或獲取紙質(zhì)票據(jù),確保合規(guī)報(bào)銷或個(gè)人留存。

- 信息核對(duì)與更正:若票據(jù)信息(如姓名、金額)有誤,服務(wù)可提供更正流程咨詢,避免影響使用。

- 遺失補(bǔ)辦與查詢:針對(duì)票據(jù)丟失情況,協(xié)助考生聯(lián)系相關(guān)部門辦理補(bǔ)辦或查詢存根。

- 政策解讀:解答票據(jù)相關(guān)的稅務(wù)、財(cái)務(wù)政策,幫助考生理解票據(jù)的法律效力。

考生可通過(guò)人事考試機(jī)構(gòu)的客服電話、官方網(wǎng)站的“常見(jiàn)問(wèn)題”欄目,或第三方專業(yè)咨詢平臺(tái)獲取此類服務(wù)。建議在選擇服務(wù)時(shí),優(yōu)先使用官方渠道,以確保信息準(zhǔn)確可靠。

2020年監(jiān)理考試成績(jī)查詢即將開啟,考生應(yīng)提前做好準(zhǔn)備,并合理利用票據(jù)信息咨詢服務(wù)解決后續(xù)問(wèn)題。預(yù)祝各位考生取得理想成績(jī),順利邁向職業(yè)新階段!如有更多疑問(wèn),請(qǐng)及時(shí)查閱官方公告或咨詢專業(yè)人士。